La Memoria Caché: Qué es, Cómo Funciona, Para Qué Se Usa y Su Rol en los Sistemas Operativos Modernos

La memoria caché es uno de los pilares fundamentales del rendimiento en la informática actual. Se trata de una capa de almacenamiento de alta velocidad que guarda temporalmente copias de datos o instrucciones frecuentemente utilizados, permitiendo acceder a ellos de forma mucho más rápida que desde la memoria principal (RAM) o el almacenamiento secundario (disco duro o SSD). Gracias a ella, los sistemas informáticos evitan cuellos de botella y mejoran la experiencia del usuario en prácticamente todos los dispositivos, desde smartphones hasta supercomputadoras.

En este artículo exploraremos de forma amplia y detallada qué es la memoria caché, su funcionamiento, tipos, usos y, especialmente, cómo la gestionan los principales sistemas operativos del mercado (Windows, macOS/iOS, Linux, Android y otros). Todo ello con base en conceptos técnicos actualizados al 2026.

¿Qué es la memoria caché?

La memoria caché (del inglés cache, que significa “escondite” o “depósito”) es una memoria auxiliar de acceso ultrarrápido que actúa como intermediaria entre el procesador y las fuentes de datos más lentas. Su principio básico se basa en la localidad de referencia:

- Localidad temporal: Si se accede a un dato ahora, es probable que se vuelva a necesitar pronto.

- Localidad espacial: Si se accede a un dato, es probable que se necesiten datos cercanos en memoria.

Al almacenar solo un subconjunto de datos (no todo el contenido), la caché intercambia capacidad por velocidad. Los datos se guardan en hardware rápido (como SRAM en la CPU) o en software (porciones de RAM). Sin ella, incluso los procesadores más potentes se verían limitados por la latencia de la RAM o el disco.

Cómo funciona la memoria caché

El proceso es sencillo pero eficiente:

- La CPU o el sistema solicita un dato.

- La caché lo busca primero (cache hit o acierto): si está, se devuelve en nanosegundos.

- Si no está (cache miss o fallo), se carga desde la fuente original (RAM, disco, red) y se copia en la caché para futuras peticiones.

- Cuando la caché se llena, se aplican políticas de reemplazo como LRU (Least Recently Used – el menos usado recientemente), FIFO o aleatorio para expulsar datos antiguos.

Existen también políticas de escritura:

- Write-through: Se escribe simultáneamente en caché y en la fuente principal (más seguro, pero más lento).

- Write-back: Se escribe solo en caché y se actualiza la fuente después (más rápido, pero riesgo de inconsistencia si hay fallo).

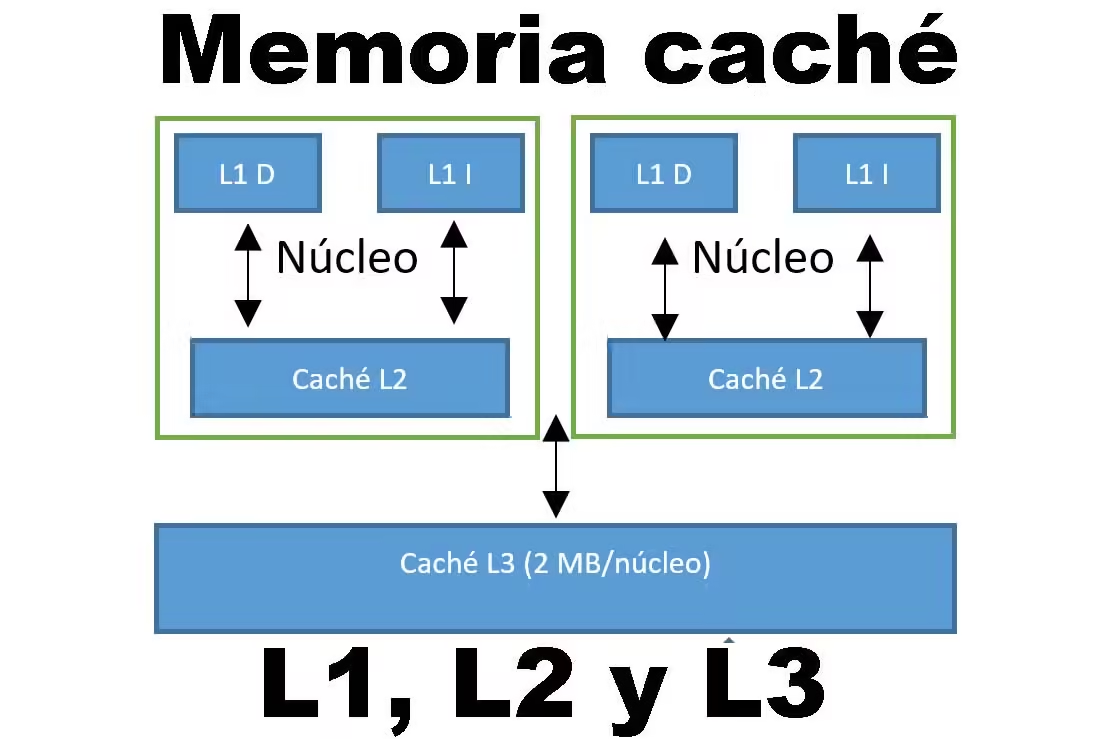

En hardware, la caché se organiza en niveles (L1, L2, L3), donde L1 es la más rápida y pequeña, y L3 la más grande y compartida.

Tipos de memoria caché

Se clasifican principalmente en dos grandes categorías:

- Caché de hardware:

- CPU Cache: L1 (dividida en instrucción y datos, por núcleo, ~32-128 KB), L2 (por núcleo o compartida, cientos de KB a MB) y L3 (compartida por todos los núcleos, decenas de MB). En procesadores modernos como Intel Core o AMD Ryzen, la L3 puede superar los 100 MB.

- GPU Cache: Similar, para gráficos y computación paralela.

- Caché en SSDs y discos: Pequeña memoria DRAM o SLC NAND para buffering.

- Caché de software:

- Page Cache / Buffer Cache: El SO usa RAM libre para guardar bloques de archivos leídos o escritos recientemente.

- Dentry e Inode Cache (en sistemas Unix-like): Estructuras que aceleran la búsqueda de directorios y metadatos de archivos.

- Caché de aplicaciones: Navegadores (imágenes, CSS, JS), bases de datos (query results), DNS cache, etc.

- Caché de red: Proxies, CDN (Content Delivery Networks) y cachés de API.

- Caché de contenido multimedia: En streaming o apps de imágenes (como Glide en Android).

¿Para qué se usa y quién la usa?

Usos principales:

- Acelerar el acceso a datos frecuentes (hasta 100-1000 veces más rápido que la RAM).

- Reducir latencia y consumo de energía.

- Mejorar el rendimiento global del sistema, especialmente en multitarea, gaming, edición de vídeo y servidores.

- Optimizar recursos en entornos con almacenamiento lento (HDD, redes).

Quién la usa:

- Hardware: Todos los procesadores (Intel, AMD, ARM, Apple Silicon), GPUs (NVIDIA, AMD) y dispositivos de almacenamiento.

- Sistemas operativos: Gestionan la caché de archivos y procesos para todo el sistema.

- Aplicaciones y servidores: Navegadores (Chrome, Firefox), bases de datos (MySQL, PostgreSQL con query cache), servidores web (Apache/Nginx con proxy cache), apps móviles y servicios en la nube (AWS ElastiCache, Azure Cache).

- Usuarios finales: Cualquiera que use un ordenador, smartphone o servicio web. En entornos empresariales, es crítica para bases de datos y CDN.

La memoria caché en los diferentes sistemas operativos

Cada SO gestiona la caché de forma adaptada a su kernel y filosofía. A continuación, un análisis detallado de los principales del mercado.

Windows (Microsoft)

Windows utiliza intensivamente el page cache para almacenar datos de archivos en RAM libre. El servicio SysMain (anteriormente SuperFetch) analiza patrones de uso y precarga aplicaciones y datos frecuentes en memoria para lanzamientos más rápidos.

- ReadyBoost (aún disponible en Windows 11/12): Permite usar memorias USB o tarjetas SD como caché adicional en sistemas con HDD lentos o poca RAM (ideal para equipos antiguos).

- Gestión: El SO prioriza la caché de archivos sobre otros usos de RAM, pero libera memoria automáticamente cuando una app la necesita.

- Ventajas: Excelente para multitarea en PCs de escritorio. En servidores, se combina con Storage Spaces y caching de Hyper-V.

macOS e iOS (Apple)

macOS (basado en Darwin/XNU) utiliza el Unified Buffer Cache (UBC), que unifica page cache y buffer cache en una sola estructura. Es agresivo al usar RAM libre para caché y no es fácilmente tunable por el usuario (a diferencia de Linux).

- En iOS (y macOS con Apple Silicon), la memoria unificada (Unified Memory) integra RAM y caché de GPU, optimizando para apps móviles y edición.

- Content Caching: En macOS Server o configuraciones familiares, permite caché compartida de actualizaciones y descargas en red local.

- Gestión: Se puede purgar manualmente con el comando

purgeo borrando carpetas ~/Library/Caches. Activity Monitor muestra estadísticas de caché. - Filosofía: Prioriza fluidez y batería; el sistema libera caché automáticamente ante presión de memoria.

Linux (distribuciones como Ubuntu, Fedora, Debian)

Linux es el más configurable. El page cache usa toda la RAM libre disponible para datos de archivos (se ve en free -h como “Cached”). Además:

- Dentry cache y Inode cache: Aceleran búsquedas de directorios y metadatos.

- Parámetros clave (tunables vía

sysctlo/proc/sys/vm/): vm.swappiness: Controla cuándo se usa swap (predeterminado 60; bajar a 10 para servidores con mucha RAM).vm.vfs_cache_pressure: Prioriza retener o liberar dentry/inode cache (valor 100 = equilibrado).echo 3 > /proc/sys/vm/drop_caches: Libera caché manualmente (útil para pruebas).

Es ideal para servidores y entornos de alto rendimiento (Kubernetes, bases de datos). Distros como Red Hat lo optimizan para cargas empresariales.

Android (basado en Linux + ART)

Android hereda el page cache y dentry/inode del kernel Linux. Además:

- Zygote: Proceso padre que precarga clases, librerías y recursos del framework Android. Al lanzar una app, se hace un fork (copia) del Zygote, ahorrando tiempo y memoria (efecto caché de procesos).

- ART (Android Runtime): Compila apps a código nativo (OAT files) y usa caché en

/data/dalvik-cache/para ejecuciones rápidas. - Caché a nivel de app: Bibliotecas como LruCache (en memoria) o Glide/Picasso (imágenes en disco y memoria). Las apps usan estrategias como “cache-first” o “stale-while-revalidate”.

En Android 14/15+, la gestión es más agresiva para ahorrar batería y mejorar multitarea.

Otros sistemas operativos

- Chrome OS (basado en Linux): Usa page cache similar a Linux. Libera automáticamente caché y archivos temporales cuando falta espacio. Ideal para web y ligereza.

- FreeBSD y derivados (como TrueNAS): Tienen un page cache muy eficiente y tunable (ARC cache en ZFS para almacenamiento). Muy usado en servidores NAS.

- Sistemas embebidos y RTOS (como en IoT): Cachés mínimas por limitaciones de hardware, pero siguen el mismo principio de localidad.

Conclusión: La caché como motor invisible del rendimiento

La memoria caché es esencial en todos los niveles de la computación moderna. Sin ella, los sistemas serían notablemente más lentos y menos eficientes energéticamente. Los SO han evolucionado para gestionarla de forma inteligente: Windows prioriza precarga predictiva, Apple enfoca en fluidez unificada, Linux ofrece control total y Android optimiza para móviles.

En la práctica, los usuarios pueden beneficiarse limpiando cachés ocasionalmente (en navegadores o apps), pero nunca es recomendable desactivarlas por completo (puede empeorar el rendimiento). Para entornos avanzados, ajustar parámetros (especialmente en Linux) permite optimizaciones específicas.

Entender la memoria caché no solo ayuda a diagnosticar problemas de rendimiento, sino a apreciar cómo la informática moderna hace posible la velocidad que damos por sentada en nuestro día a día.